论文:https://arxiv.org/pdf/2401.10020.pdf

研究者们提出了一种创新的模型训练方法,让模型自动生成训练数据,并评估数据质量,然后用这些数据自我训练。🙃

这一方法让模型在不断的训练中自我改进。

研究结果显示,在AlpacaEval 2.0排行榜上,模型表现超过了Claude 2、Gemini Pro和GPT-4 0613等。

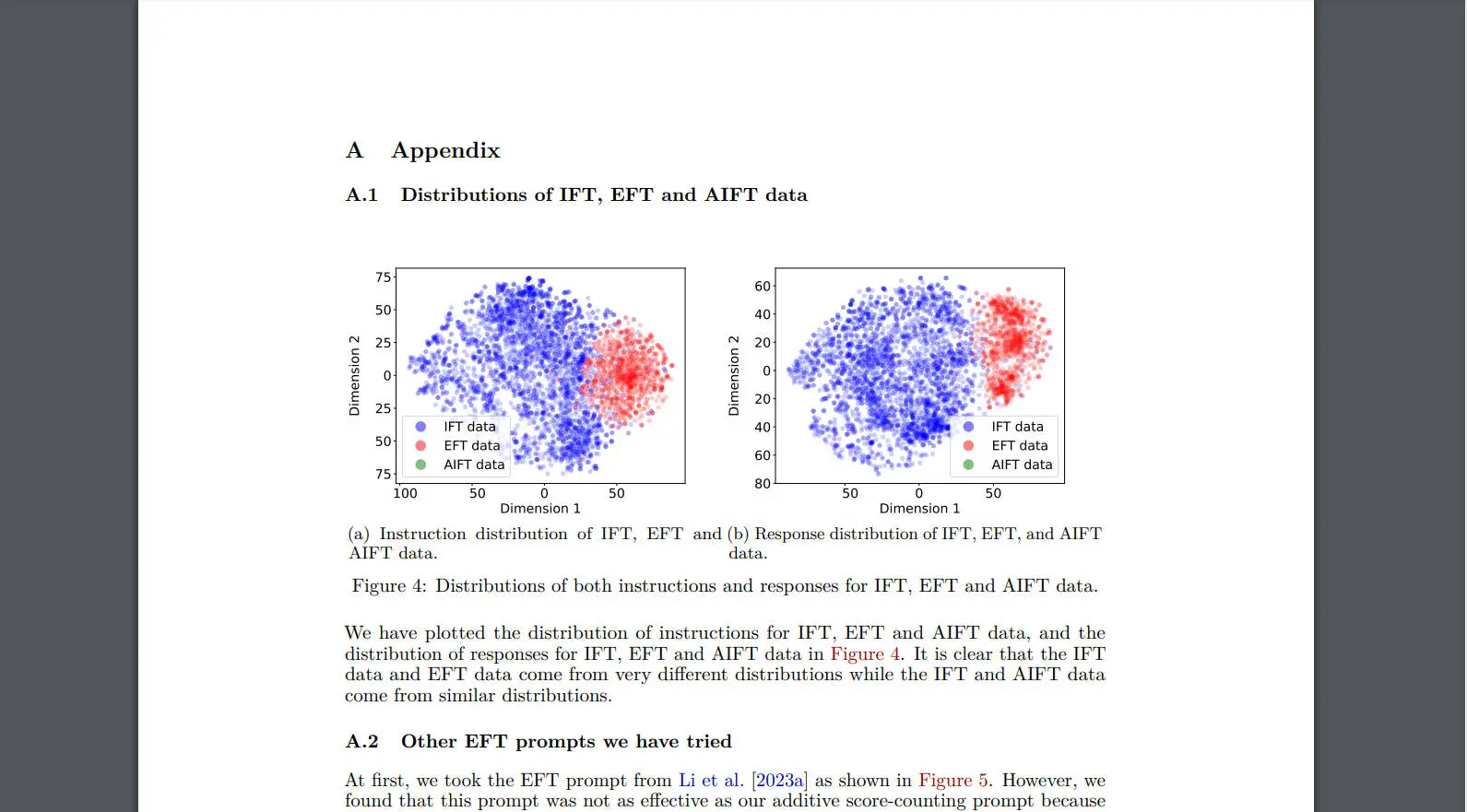

具体步骤:

- 起步: 从一个已经训练好的语言模型开始,并准备一小部分由人类标注的初始训练数据。

- 自主生成指导: 模型创造新的提示(问题或指令),这些提示是模型基于已有的训练数据自动生成的。对于每个新提示,模型生成多个不同的回答(备选响应)。

- 自我评价: 模型然后对这些备选响应进行评估,为每个回答打分。打分基于模型自身的判断,比如回答的相关性、准确性、信息量等。

- 生成训练数据集: 根据打分,选择最佳和最差的回答,形成一个新的训练数据集,其中包含原始提示、最佳回答和最差回答。这个数据集用来训练模型,使其更好地理解如何生成高质量的回答。

- 迭代训练: 使用新生成的训练数据对模型进行进一步训练。训练后的模型再次执行上述步骤,生成新的训练数据。这个过程可以多次迭代,每一次迭代都旨在提高模型的性能。

通过这种方式,模型不仅学会了更好地回答问题,还学会了如何生成有用的训练数据和如何自我评估,从而在每一次迭代中都能提高自己的性能。

这种方法的核心在于模型能够在训练过程中不断自我完善,减少对外部数据和评估的依赖。🌟